共计 3428 个字符,预计需要花费 9 分钟才能阅读完成。

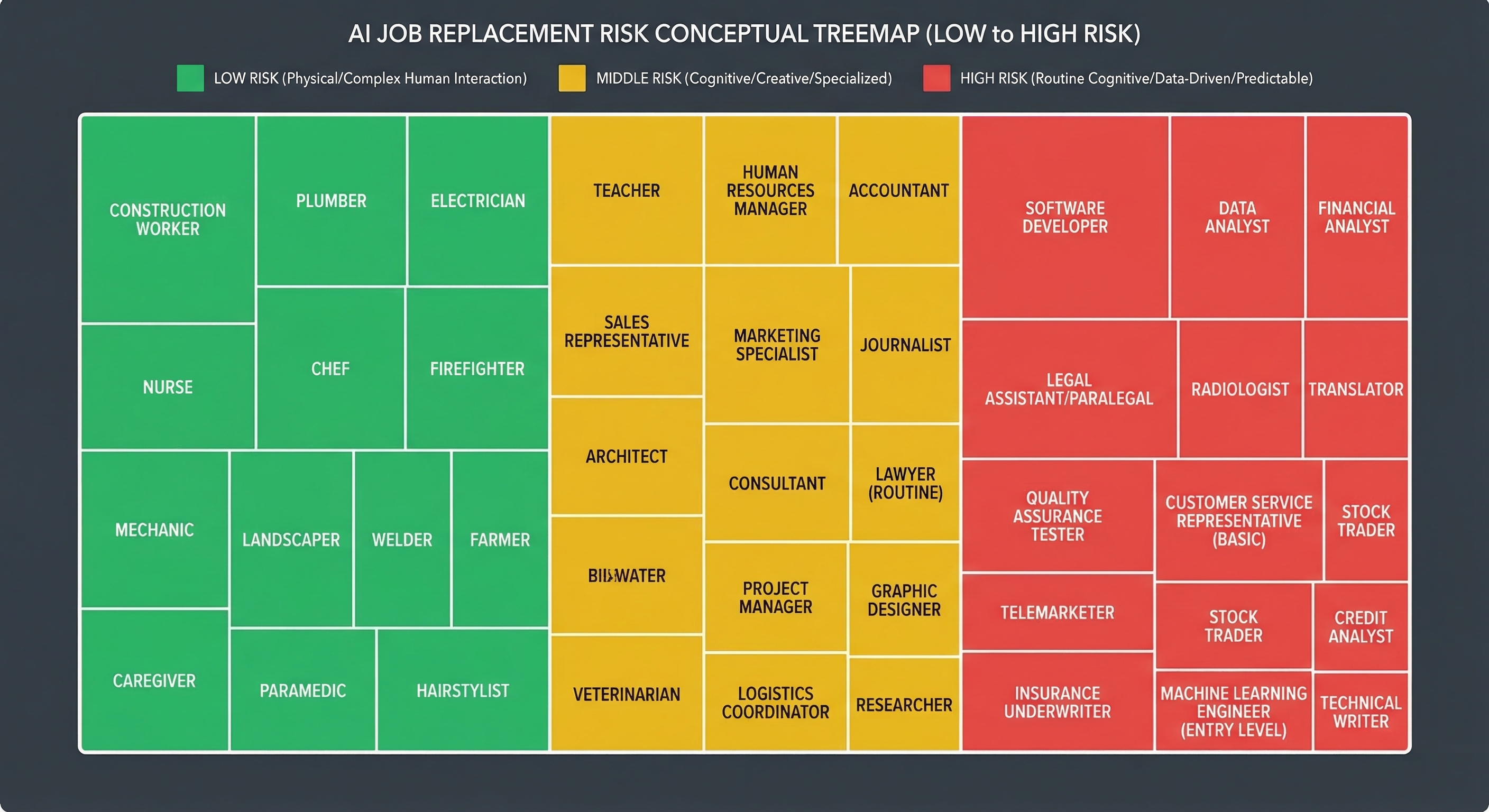

2026 年 3 月 15 日,[[Andrej Karpathy]] 在个人网站上发布了一个名为 AI Exposure of the US Job Market 的交互式可视化项目。他从美国劳工统计局(BLS)抓取了 342 个职业的数据,涵盖约 143 万个工作岗位,然后让 LLM 按照一套详细的评分标准,为每个职业打出 0 到 10 的 AI 替代风险分数。最终结果以 treemap(矩形树图)的形式呈现——矩形面积代表该职业的就业人数,颜色从绿到红代表被 AI 替代的可能性从低到高。

项目上线后迅速走红,[[Elon Musk]] 在 X 上回复称「所有工作都将变成可选的」(All jobs will be optional),各大新闻媒体纷纷报道。然而就在发布数小时之内,Karpathy 删除了 GitHub 上的源代码仓库,以及网站(karpathy.ai/jobs)。他后来表示,「这只是周六早上两小时的 vibe coded 项目,灵感来自我正在读的一本书」。

Karpathy 是谁

Andrej Karpathy 是深度学习领域最有影响力的人物之一。他是 [[OpenAI]] 的联合创始人,曾担任 [[Tesla]] 的 AI 总监,负责自动驾驶视觉系统。离开 Tesla 后,他回到 OpenAI 工作了一段时间,后来创办了 AI 教育公司 [[Eureka Labs]]。他在 YouTube 上的 AI 教学视频(如 Zero to Hero 系列)广受欢迎,是 AI 社区中极具影响力的布道者。

正因为 Karpathy 在 AI 领域的权威地位,这个本质上是一个周末小项目的可视化分析,引发了远超预期的关注和讨论。

核心发现

整体风险水平

342 个职业的加权平均 AI 替代风险分数为 4.9 到 5.3(不同来源的报道数据略有差异),这意味着美国就业市场约有一半左右的岗位面临中等以上的 AI 替代压力。

高风险职业(7 分以上)

42% 的职业得分在 7 分以上,涉及约 5990 万工人和 3.7 万亿美元的年薪资总额。典型的高风险职业包括:

- 医疗转录员:10 分(满分),被认为几乎可以完全被 AI 替代

- 会计和审计师:9 分

- 律师:9 分

- 软件开发人员:8-9 分

- 数据分析师:8-9 分

- 律师助理:8-9 分

- 客服代表:8 分

低风险职业(0-1 分)

需要体力劳动、物理在场或在不可预测的现实环境中操作的职业得分很低:

- 屋顶工人:0 分

- 清洁工:0-1 分

- 建筑工人:1 分

- 家庭护理助理:1 分

- 重型卡车司机:1 分

- 水管工:0-1 分

收入与风险的反直觉关系

Karpathy 的数据揭示了一个反直觉的现象——收入越高,AI 替代风险越大:

| 收入水平 | 平均 AI 替代风险分数 |

|---|---|

| 年收入低于 3.5 万美元 | 3.4 |

| 年收入超过 10 万美元 | 6.0-6.7 |

同样的,学历越高,替代风险反而越高:

| 学历要求 | 平均 AI 替代风险分数 |

|---|---|

| 无学位要求 | 2.7 |

| 学士学位 | 5.7 |

| 博士学位 | 5.7 |

这与很多人的直觉相反。传统观念认为「多读书就能不被淘汰」,但在 AI 时代,恰恰是那些坐在电脑前处理文字、数据和代码的白领工作者面临更高的替代风险。

一条核心规律

Karpathy 评分体系的核心判断标准是:如果一份工作的产出本质上是数字化的,而且可以完全在家办公完成,那么这份工作的 AI 替代风险天然就很高。反之,需要物理存在、手工操作或应对不可预测现实环境的工作,暂时是安全的。

方法论与争议

项目的技术实现

整个项目的流程是开源的:

- 从 BLS 的 Occupational Outlook Handbook 抓取 342 个职业的数据

- 将每个职业的描述喂给 LLM(据报道使用的是 [[Gemini]] Flash),按照预设的评分标准进行打分

- 将评分结果生成交互式 treemap 可视化

Karpathy 自称这是一个「vibe coded」的项目——也就是凭感觉快速搭建的原型,而非经过严格论证的学术研究。

主要批评

这个项目引发了大量争议,主要集中在以下几个方面:

第一,循环论证问题。用 LLM 来评估工作被 LLM 替代的可能性,存在明显的自指偏差。LLM 天然倾向于高估自己能做的事情。Karpathy 本人对此是透明的,但在病毒式传播的过程中,这些 caveat 被大量忽略了。

第二,对体力劳动替代风险的盲区。评分体系只关注了 LLM 层面的替代,完全忽略了机器人、自动驾驶等技术对体力劳动的威胁。比如卡车司机得了 1 分,但自动驾驶行业正在快速发展。

第三,确认偏误(Confirmation Slop)。Stacker News 上的评论者指出,Karpathy 在给 LLM 的 prompt 中预置了偏向性的框架和示例,导致输出结果本质上只是在「回填」(backfill)研究者预设的结论。有人为此创造了一个新术语——Confirmation Slop,即通过预设偏见的 prompt 工程让 LLM 生成符合预期的「研究成果」。

第四,与现实数据矛盾。[[Citadel Securities]] 指出,Indeed 的职位发布数据显示,2026 年初软件工程师的需求同比增长了 11%。尽管 Karpathy 的分析给软件开发人员打了 8-9 分的高风险,但现实中的招聘市场并没有显示出相应的萎缩。

第五,数据的误导性。3.7 万亿美元的数字听起来触目惊心,但这只是高风险职业的年薪资总额,并不意味着这些钱会「消失」。大多数工人会适应、转型或看到自己的工作内容演变,而不是直接失业。

为什么发布后又删除

关于 Karpathy 为什么快速删除 GitHub 仓库,他没有给出明确的公开解释。但从各种迹象来看,可能的原因包括:

- 项目的传播规模远超预期,一个周末小实验被当作权威研究来引用

- Elon Musk 的回复进一步放大了影响,使得讨论脱离了 Karpathy 原本想表达的范畴

- 删除仓库但保留网站,说明他想保留自己对展示方式的控制权,防止原始数据和代码被 fork 后以各种方式被修改和重新分发

不过,有人在仓库被删除之前就 clone 了完整的代码和数据,并重新上传到了 GitHub,所以代码实际上仍然可以被获取。

一个更深层的视角:可验证性

值得注意的是,Karpathy 在 2025 年 11 月曾提出过一个更精确的分析框架。他认为,判断一个任务是否会被 AI 替代,关键不在于它是否「重复」,而在于它是否「可验证」——具体来说要满足三个条件:

- 环境可重置(可以开始新的尝试)

- 试错成本低(可以进行大量尝试)

- 可自动奖励(存在某种自动化的评价机制)

这个框架比简单的 0-10 打分更具解释力。它解释了为什么 AI 能下棋但写不出伟大的小说,为什么 [[AlphaFold]] 能预测蛋白质结构但不能取代实验科学家。编程任务之所以特别容易被 AI 接管,正是因为它完美满足这三个条件:编译器可以检查语法,单元测试可以验证逻辑,性能指标可以量化优化效果。

对普通人意味着什么

Karpathy 的这个项目虽然方法论上存在缺陷,但它提供了一个有价值的思考框架。以下几点值得关注:

第一,屏幕前的工作比体力劳动更先受到冲击。这与很多人的直觉相反,但确实是当前 LLM 技术发展的逻辑结果。处理文本、数据、代码的工作本质上就是 LLM 最擅长的领域。

第二,「AI 替代」不等于「失业」。更准确的理解是:AI 会改变工作的内容和方式,让同样的产出需要更少的人。一个 30% 的生产力提升不会让所有人失业,但会让企业在边际上减少招聘。

第三,不要把这当作预言。Karpathy 自己也说过,理论上的「AI 能做」和现实中的「AI 在做」之间存在巨大的鸿沟。组织惯性、监管要求、客户信任等因素都会大大减慢实际的自动化进程。

第四,关注自己工作中的「不可验证」部分。根据 Karpathy 的可验证性框架,那些需要人类判断力、创造力、实地经验和跨领域整合能力的工作环节,是最不容易被替代的。与其焦虑分数是多少,不如思考如何让自己的工作向「不可验证」的方向倾斜。

后续影响

这个项目虽然只存活了几个小时就被删除,但它引发的讨论不会就此结束。它实际上揭示了当前 AI 讨论中的几个结构性问题:

- AI 领域的权威人物发布的即兴分析,会被公众当作严谨研究来对待

- 媒体和社交网络的传播速度远超纠错速度,caveat 和限制条件永远跑不过标题党

- 我们缺乏一个被广泛认可的、量化 AI 对就业影响的标准方法论

无论如何,这个可视化本身是值得一看的。它把一个抽象的问题——AI 会影响哪些工作——变成了一幅直观的图景。即使分数不够精确,它至少让每个人都开始认真思考:在 AI 时代,我的工作将会如何改变?

相关链接

- karpathy.ai/jobs – Karpathy 的交互式可视化(网站仍在线)

- Awesome Agents 报道

- Fortune 报道

- Glen Rhodes 深度分析

- Stacker News 讨论